Medizinische Studien durchzuführen bedeutet - neben den notwendigen Therapiekenntnissen - auch über mehr als grundlegende Statistikkenntnisse zu verfügen. Oder das Glück zu haben, einen Statistiker als Co-Autor gewinnen zu können.

Selbst wenn diese Voraussetzungen vorhanden sind bedeutet das Ergebnis einer solchen Studie nicht, daß jetzt ein allgemeingültiges Dogma verkündet würde - vielmehr wird eine Aussage über eine gewisse Wahrscheinlichkeit * gemacht mit der ein in der Studie überprüftes Ergebnis eintreten kann. Aber nicht muß.

Das ist der entscheidende Punkt.

Hier trennen sich Verständnis und Urteilsvermögen

von Wissenschaftlern und Laien.

Laien nehmen Ergebnisse von Studien also als 'bare Münze' und meinen deren Ergebnisse seien allgemein übertragbar und gültig. So kommen dann Schlagzeilen wie

"Krebs besiegt!" auf die Seiten von zweit- oder drittklassigen Druckerzeugnissen.

Wissenschaftler und wissenschaftlich Gebildete hingegen interpretieren dergleichen mit der nötigen Vorsicht und erst wenn sich - in wiederholt durchgeführten Studien - frühere Ergebnisse wiederholen lassen, messen sie ihnen eine gewisse Bedeutung bei. Was noch nicht heißt, daß sie sie für allgemeingültig halten. Sie sind - selbst nach mehreren Wiederholungen - lediglich wahrscheinlicher geworden.

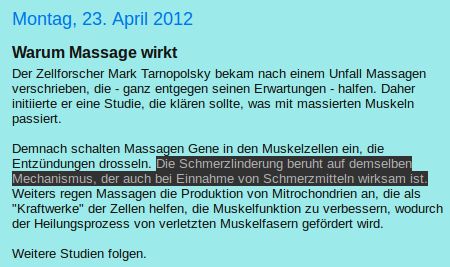

Kürzlich sah ich wieder ein trauriges Beispiel für diese mangelnde Urteilsfähigkeit in einem Weblog. Die Interpretation war dementsprechend mangelhaft und typisch für unbedarfte Laien:

Der gepriesene "Zellforscher" hat gleich mehrere grundlegende Fehler gemacht die seine "Studie" als wissenschaftlichen Schrott kennzeichnen:

- publication bias (Verzerrung) **

- Blindungsfehler ***

und

- unzureichende Fallzahlen ****

Aus der Pressemitteilung haben unzählige unwissende Redakteure/-innen abgeschrieben/wörtlich übernommen und so mehr oder weniger verkürzte und damit noch weniger wissenschaftliche Artikel 'verfaßt'. Die Blogschreiberin, offenbar bedauerlicherweise naturwissenschaftlich nicht sehr gebildet, konnte z.B. noch nicht einmal sinngemäß wiedergeben was da stand und hat eine Passage genau ins Gegenteil dessen verkehrt was in der Pressemitteilung bekannt gemacht worden war [siehe Hervorhebung]. Bei der mangelhaften Qualität der Studie fällt das aber kaum noch ins Gewicht.

Studien mit solchen Fallzahlen - im vorliegenden Fall waren es elf (!) Probanden - sind bestenfalls Geldverschwendung, meist aber Arbeiten zu nur einem Zweck:

Sie erhöhen die Zahl der Publikationen und damit das Bleiberecht der Autoren im U.S.-Wissenschaftsbetrieb.

Um das beurteilen zu können muß man nicht unbedingt dort gelehrt haben.

Es reicht, wenn man ein wenig Sachverstand hat, der nicht vom Gedanken des persönlichen Profits korrumpiert ist, kritisch liest und vor allem nicht alles, was in einschlägigen Werbeblättern und Fitnesszeitschriften steht, blauäugig konsumiert ....

*

Testverfahren sollen Hypothesen (=vermutete Sachverhalte) anhand von Versuchsergebnissen gegenüber täuschenden Zufallseffekten absichern.

Resultat eines statistischen Schlusses ist eine bestimmte Wahrscheinlichkeit .. Eine getroffene Aussage .. kann nicht als sicher, sondern als mehr oder weniger wahrscheinlich gewertet werden. Immer bleibt eine gewisse Wahrscheinlichkeit, dass die Aussage mit einem Fehler behaftet ist.

[http://user.meduni-graz.at/helmut.hinghofer-szalkay/Biometrie.htm]

Kurzfassung:

Jede Studie kann nur Wahrscheinlichkeit, nie Gewißheit darstellen.

Wird daher eine Gewißheit postuliert muß man eine Täuschung(-sabsicht) unterstellen.

**

Bias (Systematische Fehler)

HIER => Publication Bias:

Es werden nur Studien publiziert die einen positiven Effekt einer medizinischen Massnahme nachweisen und negative Studien werden nicht publiziert.

[http://www.awanet.ch/nv/EBM/Glossar.asp#Randomisierung%20%28Randomized,%20Random%20allocation,%20Randomisation%29]

Kurzfassung:

Die publizierende Person 'will' keine negativen Ergebnisse veröffentlichen.

Publizierte Ergenisse sind stets positiv hinsichtlich der Grundannahme.

***

Blindungsfehler

Blindung bedeutet, dass die betreffende Person (Proband/In, Therapeut/In oder Untersucher/In) nicht gewusst hat, welcher Gruppe der Proband zugeordnet worden ist. Außerdem wird eine Blindung von Probanden und Therapeuten nur dann als gegeben angenommen, wenn davon ausgegangen werden kann, dass sie nicht in der Lage gewesen wären, zwischen den Behandlungen, die in den verschiedenen Gruppen ausgeführt wurden, zu unterscheiden.

[http://www.pedro.org.au/german/downloads/pedro-scale/]

Kurzfassung:

Wissen Untersucher und Probanden von ihrer Gruppenzugehörigkeit ist das Ergebnis nicht vertrauenswürdig. Weiß nur der Untersucher davon ist das Ergebnis verfälscht. Mit geringerer Wahrscheinlichkeit gilt dies für Probanden.

****

"Gleichheit"

Eine echte Gleichheit muss in Studienzahlen mit wesentlich höheren Fallzahlen belegt werden .. Eine höhere Fallzahl ließe den statistischen Unterschied zwischen den einzelnen Gruppen, d. h. die Streuung sinken, so dass das Konfidenzintervall (= Vertrauensbereich, je kleiner, desto besser) enger werden würde. Lässt somit eine klinische Studie, aufgrund einer zu geringen Fallzahl, keine eindeutigen Rückschlüsse zu, ist sie unterdimensioniert, d. h. sie liefert nicht die ausreichende statistische Power, um eine fallzahlabhängige Trennschärfe eines statistischen Tests zu erzielen.

[http://www.uniklinikum-saarland.de/profil/freunde-des-uks/klinische-studien/]

Kurzfassung:

Hohe Fallzahlen reduzieren die Streuung und erhöhen den Vertrauenesbereich.

Niedrige Fallzahlen erhöhen die Streuung und vermindern den Vertrauensbereich.